DAWで使えるバーチャルシンガーとしては、「初音ミク」が超有名ですが、どうもAI(人工知能)でメロディーと歌詞を分析し、「それっぽく勝手に歌ってくれる」NEUTRINOというソフトがあるらしいです。

そのNEUTRINOのバーチャルシンガー「東北きりたん」がつよい!というのを聞いて、試してみました。そして本当に強かった!

AIきりたんとは

要はボーカロイドみたいな歌声を合成してくれるソフトです。これのすごいのはなんもしないでも、それっぽい歌い方に調整してくれることです。

楽譜から発声タイミング・音の高さ・声質・声のかすれ具合などをニューラルネットワークで推定します。上記の推定されたパラメータを元にvocoderで音声を合成します。

https://n3utrino.work/ 公式サイトより

かっこええ。。。ディープラーニングのサンプルって、画像認識が多いですが、こういう応用を考えて実装できるというのがすごいなあ。

ちなみに、このソフトの名前は、NEUTRINOというソフトでその中のバーチャルシンガーが「東北きりたん」というキャラです。他にも数人いるようです^^

さっそくサンプル曲作ってみた

というわけで作ってみました。

これはなんの調整もしてません。ただ、メロディー入れて歌詞を当て込んだだけです。

ボーカロイドも使ったことあるのですが、それに比べるとかなり自然にうたってくれますね!びっくりした。ちょっとしたところのしゃくりあげ方とか、アクセントの付け方とかが「それっぽい」!

いやー、おもしれえ。。。

Logicでの使い方

検索すると解説してくれるサイトがあるのですが、若干それと違ったこともしたので、その部分だけ、メモしておきます。

さて、予備知識がなかったので驚いたんですが、このNEUTRINO。コマンドラインで使用します。

GUIはなし!趣味・お仕事でターミナルをいじる人ならすんなりいけると思いますが、そうでない人は最初はとっつきにくいと思われます。

NEUTRINOは、musicxmlファイルを解析して歌声ファイルを生成してくれるのですが、Logicもmusicxmlを作成可能です。

普通にメロディーを打ち込んで、「スコア」画面で歌詞を入れていけば良いだけです。

で、「スコア」の画面を出した状態で、「ファイル」ー「書き出し」ー「MusicXMLで書き出し」を選択すれば良いです。

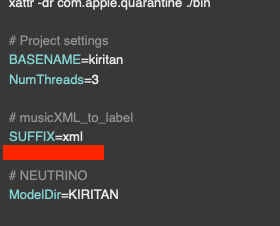

これで出来上がるファイルは「XML」ファイルです。NEUTRINOの使い方では、Run.shの書き換えでBASENAMEを書き換えるように言っていますが、ついでにSUFFIXも書き換えるとLogicの人は便利じゃないでしょうか。

ここ、もともとmusicxmlと書いてありました。これだとLogicが出力したファイルの拡張子を変更する必要があって面倒なので、変更しちゃった方が楽ですね。

トライアンドエラーが必要

歌声生成したものを聞いてみると、「ここが長すぎる」「ここが変」というのが出てきます。

すると、音符の長さを微調整したり、入力間違えした歌詞を修正する必要があります。これをLogicで行って、XMLで書き出して、コマンドラインで生成して、出来上がったファイルをLogicに貼り付けて、、、という工程になるので、まあ、、、面倒ですw

ボーカロイドですらDAWとの連携という意味では完全体には程遠いので、今後の改善に期待です。

さて、音符の長さは出来上がりの歌声にかなり影響があります。これはボーカロイドもそうですね。今回のデモ曲の最後の「えーあい〜、きりたーん」と歌ってるところがなかなか思い通りにならず何回も生成し直しました。

ほんとは、もうちょい音を伸ばしたいんですが、伸ばすと「きりたーん」の「ん」が妙に強調されて変なんですよね。。。弱い「ん」を出したいのですが、なんかやり方あるのかな。多分あるでしょう。

「はい、おわり」という歌詞が2回続くのですが、最初のは「はい」は短い音符にするとちゃんと歯切れ良く「はいっ」と発音し、伸ばしてるのはまったり「はい」となってます。

ほかにも弱い「い」を出したいとかありますが、まあ今後の研究ということで。

とりあえずただ作っただけでここまで歌ってくれるのだからだいぶ満足です。

このすごいものがフリーソフトとは・・・

NEUTRINOというソフトはSHACHIさんと言う方が開発されて公開されています。そしてそのベースとなっている研究/エンジンは明治大学の森勢将雅(もりせまさのり)准教授によるものだそうです。ここにインタビューが載っていて面白いです。DAWで簡単に使えるプラグインができたら嬉しいですね。

ネックを調整したSuhr

今回、ギターはSuhrで弾きました。Suhrはこの記事に書いた通りネックが反ってまして、その後、自分で適当に調整しました。

これで弦高もおちつき、弾きやすさが戻ってきた。しかし、順反りが若干進んだ状態で弦高調整をしてしまったようで、3弦がややびびる。3弦だけちょっと他より低いようで、少し上げたほうがいいかなあ。。。六角レンチが見当たらずとりあえず放置してるのですが。

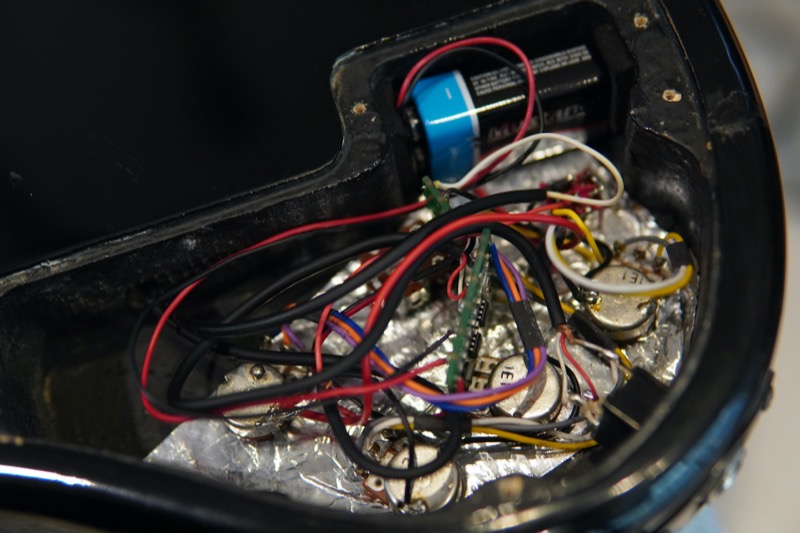

ベースは電池替えた

初めてベースの電池も替えました。多分初めてだとおもうけど、、、替えたとしても記憶はありませんw

なんとなく勝手に、アクティブ/パッシブ切り替えのベースかと思ってたのですが、どうやらフルアクティブですね。。。電池抜いたら音出なくなったw

蓋開けたらこんな感じになってました。しかしやたらネジ穴が多いのですが、なんでだろう。そんなに必要かなあ。

最近、ベースは打ち込みじゃなくて弾いてるのですが、今回のデモ曲くらいのスピードでも結構きつい。フィルなどで音を移動しようとするとたどたどしくなりますね。単純にギターより移動距離が長いので難しい。

ミックスもトライアンドエラー

ブログ始めた当時から、あれこれ動画作ってみてはアップしてみたのですが、その時その時の実力に応じて、それなりによくできたと思ってアップしてるわけです。

しかし時間を置いて聞き直すと、演奏もミックスも全然ダメだなあ、、、と思うことが多いです。

最近で言うと、このメタル風の音作るのトライした動画は、完成した直後は結構いい感じだと思っていたのです。

しかし、ヘッドフォンMDR-1STを買って聞き直してみたら、すごい嫌なところにたくさん気づいてしまった。。。肝心のギターの音が浮いてる感じがする。

その反省をもとにやったワウを使ってみた動画ではだいぶ改善された、、、と「今のところ」思っています。下の記事内の動画です。

で、今回の「AIきりたん」はどうだろうか。とりあえず作業で繰り返し聴きすぎてよくわからないw

まあでもなんでもそうですが、3歩進んで2歩下がるみたいな感じで、ずっとやってれば少しずつは上達するであろうと思われる。

今回、コンプレッサーのリリースについて、ひょっとしたらこういうことか?と思ってやってみたところ、まさに思っていた効果が出せたことがありまして、また多少理解が進んだ。

これについてはまたどっかで別の記事で書いてみたいと思います^^

コメント

今年も宜しくお願いします!

オリジナル曲、結構好きですよ。それにしてもボーカロイドもここまで進化していたんですね。

もう、普通に歌っているように聴こえます。

作曲したり作詞したり、PVの作り方を見てもnicoさんはセンスが凄く良い方だなと思います。

あ、ジョーペリーでのワウワウの方も聴きましたが、あのレスポールめちゃくちゃ音が良いですね!あ〜、これ欲しいって思いました笑

ん〜、PC新調して自分もちゃんと録音とかしようかな。

今年もよろしくお願いします!

ほんと普通に歌ってるような感じですごいですよね。動画も見ていただいてありがとうございます^^励みになります。

ジョーペリーのレスポールは1番のお気に入りです^^